世界最高クラスの日本語性能を持つ純国産生成AIの基盤モデル(PLaMo™)を開発するため、「高火力PHY」を活用

- WEBサービス&アプリ提供者

株式会社Preferred Networks

- GPUクラウドサービス

AIの社会実装を支援する株式会社ABEJA。大規模言語モデル(LLM)の研究開発のため、経済産業省とNEDOのプロジェクト「GENIAC」に採択されています。同社は各産業のミッションクリティカル業務(停止や判断ミスが事業や社会に大きな影響を与える基幹業務)におけるAI適用を目指し、モデルの学習・ファインチューニングに必要な大規模GPUリソースを確保したいと考えていました 。そこで、さくらインターネットが提供するベアメタル型クラウドサービス「高火力 PHY」を導入。安定した開発環境のもと、LLM開発を推進しています。 今回は、株式会社ABEJAのプリンシパルデータサイエンティストである服部響氏に、GENIACプログラムへの参画背景、高火力 PHYの導入経緯と効果、そして同社が描くAI社会実装の未来について聞きました。

少子高齢化や労働人口の減少が加速する現代。企業が生き残り、成長し続けるには、業務におけるAI活用は重要な選択肢の1つです。しかしAIの実務導入は現実として難しく、活用の実態は「周辺業務の効率化による業務時間の削減」にとどまりがちです。

ABEJAの服部氏は、「周辺業務で留まらず、企業の事業根幹を担うミッションクリティカル業務にこそAIを導入すべきだ」と語ります。

「周辺業務での改善は大切なスモールサクセスですが、それだけでは企業が本当に変わることはできません。AIを事業の根本に組み込んで、事業構造そのものを変革してこそ、AIの真価が発揮できます」(服部氏)

ABEJAの創業は2012年。当時の黎明期にあったディープラーニングから近年の生成AIの爆発的な普及に立ち合い、企業へのAI実装を支援してきました。同社が特に力を入れているのが、ミッションクリティカル業務への適用であり、その実現を支えるのが、自社開発のABEJA Platformです。

「基幹業務のDXに必要な設計や開発、構築、運用、改善までの全工程に関するノウハウを搭載したプラットフォームです。当社は企業のニーズに合わせ、DXをPoCで終わらせず、実装と運用まで伴走します」(服部氏)

ミッションクリティカル業務へのAI適用には、人とAIの協調も重要になります。

「人が担っていた作業に関するデータを蓄積し、AIに学習させることでAIの担当領域を段階的に広げ、人の手が必要な作業の負荷を軽減していく。この考え方が、失敗の許されない業務領域におけるAI導入を成功させる秘訣です」(服部氏)

LLMの開発には、大量のGPUリソースが不可欠です。しかし近年、生成AIの急速な普及によって世界中でGPU需要が爆発的に拡大。クラウドGPUの確保も困難な状況になっています。

「当社はGENIACプログラムの採択を受けてLLMの大規模学習に取り組むことになりました。しかし現在、世界中で『GPUリソースを確保できない』という問題が起きています。特定のGPUに制約がかかり、十分な計算ができないようなことも、めずらしくありません」(服部氏)

さらに服部氏を悩ませたのが「時間の制約」です。GENIACプログラムの補助期間は約6か月。その期間内にGPUリソースの確保、環境構築、モデルの学習、そして成果報告まで完結させなければなりません。

「AIは本当に進化が速く、ソフトウェアのバージョンやフレームワークも急速に変化しています。新しいインフラ環境を立ち上げようとしても、以前と同じ手順ではうまくいかないというのも一般的です。なるべく迅速に環境を構築し、実際の学習にかけられる時間を最大化したいと考えていました」(服部氏)

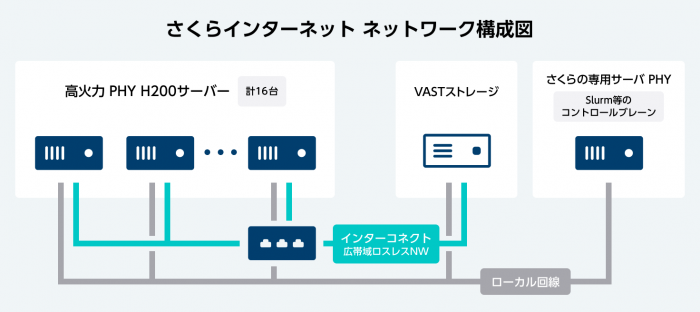

ABEJAが選んだのは、さくらインターネットのベアメタル型クラウドサービス「高火力 PHY」でした。

「もともとさくらインターネットとはつながりがあったため、話が進めやすく、助かりました。利用コストがGENIACプログラムの助成枠の中に収まるとわかったのが、導入の直接的な決め手になりました」(服部氏)

また、高火力 PHYの活用にあたっては、さくらインターネットと協力会社である株式会社フィックスターズ、プラナスソシューション株式会社が伴走型の支援をおこないました。

「LLM開発では、新しいインフラ環境を構築する際、必ずと言っていいほど何らかのトラブルが発生します。さくらインターネットでは、そうしたトラブルを想定した伴走型の支援サービスがあります。何か問題が起きた際は、開発の背景をよく理解してくれているエンジニアに直接相談できるような体制を整えてくださいました。これがとても助かりました。たとえばこれが、一般的な問い合わせフローの場合、まず状況説明から時間を要することもあるため、同等のスピード感で進めることは難しかったと思います」(服部氏)

この支援体制は、開発期間を通して提供されました。環境構築から学習中のトラブル対応まで、専門知識を持つメンバーが即座に対応。煩雑な手続きなしに、相談しやすい環境で、開発のスピードを支えました。

「相談のたびにゼロから背景情報を説明しなくていいのが、本当に助かりました。困っていることをそのまま伝えれば、すぐに意図が伝わる。さくらインターネットさんを含むパートナー企業によるワンチーム体制で、開発を進めている感覚がありました」(服部氏)

この体制のもと、開発を完遂。GENIACの補助期間内に、GPUリソースの確保から環境構築、学習の実行まで、限られた6か月を最大限に活用することができました。

「GENIACプログラムの補助期間を活かすには、開発初期段階でできるだけ速く環境を立ち上げ、可能な限り計算を実行したいところです。最終的なデータの引き上げ手順まで共有して、GPUを使える期限の直前まで計算を回せました」(服部氏)

ABEJAはGENIACプログラムを活用してLLMの大規模学習・ファインチューニングを実施。自社の技術力をさらに強化しました。企業ごとの業務データによる学習と、特定の用途に合わせたモデル調整は、ミッションクリティカル業務へのAI適用の根幹をなすものです。

今回の経験を踏まえ、服部氏はGENIACプログラムへの参画を検討する企業に向けて、以下のように語りました。

「まず、環境構築には想定以上の時間がかかることを前提に計画を立てることをおすすめします。GPUのノード数も、最初から全量を確保するのではなく、使うタイミングに合わせて計画的に用意していくと、コストと期間を無駄なく使えると思います。そして何より、トラブルが起きた時に一緒に解決してくれるサポート体制があるかどうかを、サービス選定の重要な基準にしてほしいです。LLM開発の環境に関するトラブルは、一般的な情報だけでは解決が難しい場合もあり、状況に応じた支援が重要です。自分で手を動かして困難なエラーにも向き合いより高みを目指せる人と伴走できる環境が、開発の成否を大きく左右するでしょう」(服部氏)

服部氏は今後の展望について「LLMとフィジカルAIの両軸」の研究開発を考えているとのこと。2024年11月には、ABEJA PlatformにAIロボティクスを実装済みです。

「現在は、多くの企業が『LLMを自分たちで学習させる、ローカルで動かす』といった取り組みを始めたばかり、という状況にあります。もちろんその先には、マルチモーダル対応やエージェント活用、フィジカルAI・AIロボティクスという領域が控えています。当然、これらの技術への発展は段階的に進んでいくでしょう。われわれも現在のニーズに応えながら、数年後を見据えた準備を進めているところです」(服部氏)

この流れの中で重要なのは、LLMとフィジカルAIが「それぞれが両輪となって適用領域を広げ続ける点」にあると服部氏は強調します。

「いま言語モデルで悩んでいる企業は、数年後にはフィジカルAIやその他の新しい技術で悩むことになります。AIが適用できる範囲は確実に広がり、それに伴って企業の課題や困りごとも増えたり変わったりしていく。言語モデルもまだ成熟しきっていませんし、各企業の業務領域との掛け算で考えると、伸ばせる領域はまだまだあります。現時点では、数年後がどうなるかも読めない状況ではありますが……どういう形であれ、ニーズは確実にあるでしょう。そのときどきのニーズに応えられるような研究開発を進めていきます」(服部氏)

さくらインターネットは、引き続きABEJAのLLM開発・社会実装の取り組みを、高火力 PHYで支援していきます。

※掲載の記事内容・情報は執筆時点のものです。